OpenAI представила GPT-5.5 — новую модель, которая делает заметный шаг в сторону автономной работы.

Обновление уже доступно в ChatGPT и Codex для платных пользователей, а позже появится и в API.

Главное отличие от прошлой версии — модель лучше понимает цель задачи и может сама выстраивать план действий. Теперь вместо детального контроля пользователь может дать «сырой» запрос. И ИИ сам разберется, что делать дальше.

От задач к процессам

GPT-5.5 ориентирована не на отдельные ответы, а на выполнение целых рабочих процессов. Она умеет писать и отлаживать код, анализировать данные, создавать документы и работать с разными программами, переходя между ними до завершения задачи.

Это и есть агентный подход: модель не просто отвечает, а действует. Она может проверять свои шаги, корректировать ошибки и продолжать работу без постоянных уточнений со стороны человека.

Быстрее и эффективнее

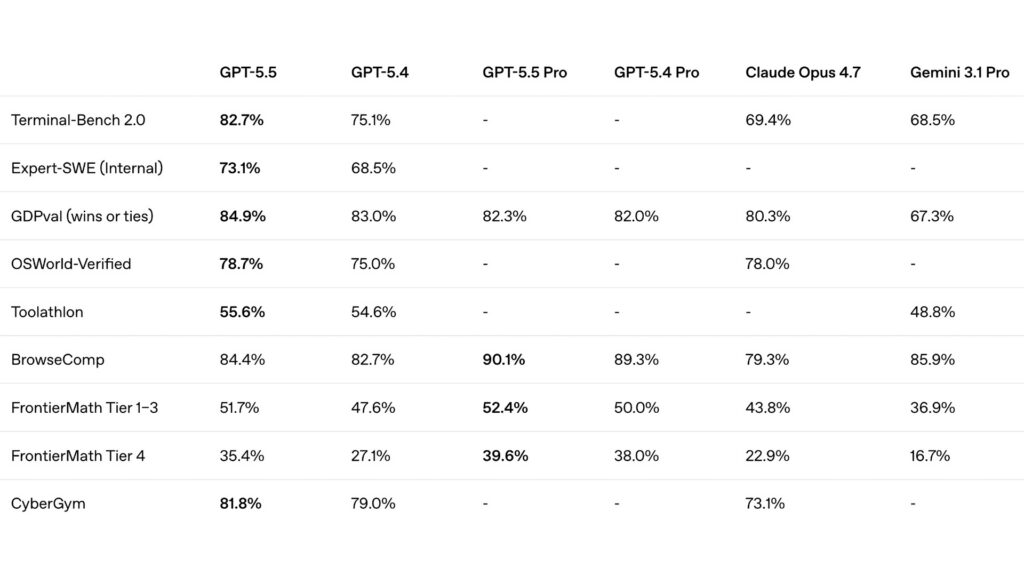

Несмотря на рост возможностей, скорость осталась на уровне предыдущей версии. GPT-5.5 работает примерно с той же задержкой, что и GPT-5.4, но при этом решает задачи лучше и использует меньше токенов.

В тестах модель показывает рост качества в программировании, работе с инструментами и сложных вычислениях. Например, она лучше справляется с длинными задачами, где нужно удерживать контекст и последовательно двигаться к результату.

Новый уровень для разработчиков и аналитиков

Особенно заметен прогресс в кодинге. GPT-5.5 способна не только писать код, но и понимать архитектуру системы, находить ошибки и предлагать изменения, которые учитывают весь проект.

По отзывам ранних пользователей, модель реже требует доработок и лучше предсказывает, какие тесты или проверки понадобятся. Это делает ее ближе к полноценному участнику команды, а не просто инструменту.

ИИ как соавтор исследований

OpenAI делает ставку не только на разработку, но и на научные задачи. GPT-5.5 лучше справляется с многошаговыми исследованиями: анализирует данные, проверяет гипотезы и помогает формировать выводы.

В ряде случаев модель уже ускоряет работу, на которую раньше уходили недели. При этом она используется не вместо специалистов, а как инструмент, который берет на себя рутину и ускоряет процесс.

Безопасность становится жестче

С ростом возможностей усиливаются и ограничения. OpenAI внедрила более строгие механизмы защиты, особенно в области кибербезопасности.

Модель проходит дополнительные проверки, а доступ к чувствительным сценариям контролируется. Это нужно, чтобы снизить риски злоупотреблений на фоне роста возможностей ИИ.