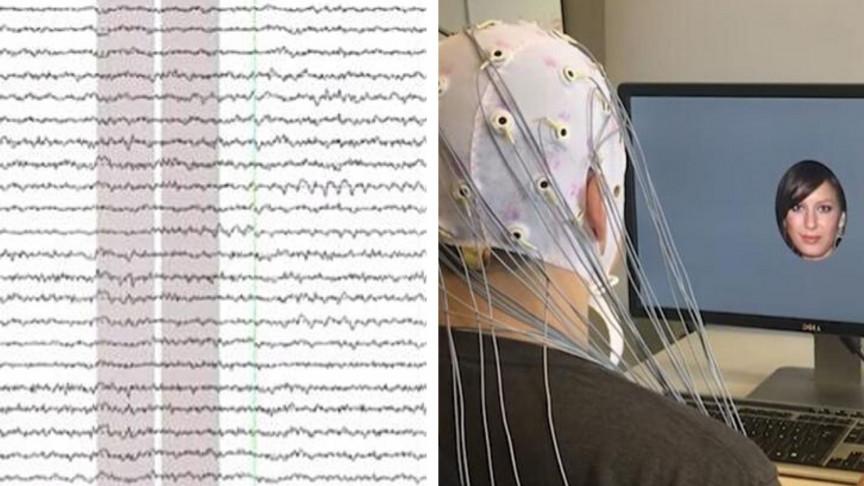

😢 Проблема: к любому устройству, которое реагирует на голос, можно получить доступ, если дать ему послушать запись голоса владельца. Подмена голосового ввода считается одной из самых простых: просто записываешь голос в одной ситуации, а воспроизводишь в другой. И такую атаку очень сложно обнаружить, потому что характеристики записи совпадают с живым голосом жертвы.

😎 Решение: Void — система обнаружения живого голоса. Он ориентируется на спектрограммы — визуализации спектра частот для обнаружения «живости» голоса, в отличие от других подобных приложений, которые используют машинное обучение. С таким подходом Void обнаруживает атаки в восемь раз быстрее, чем нейронки.

👨🔬 Кто: Data61 CSIRO вместе с Samsung Research и университетом Сунгкьюнкван, Южная Корея.

Источник: ZDNet