Ещё пару лет назад, чтобы запустить нейросеть на своём компьютере, нужно было знать Python и разбираться в коде. Сегодня достаточно скачать одну программу, и ваш личный ИИ готов к работе.

В этой подборке разбираем 10 инструментов для установки локальных нейросетей на ПК. Если нужен более широкий список open-source-решений для локальных LLM, RAG, агентов, ComfyUI, Whisper и coding CLI, отдельно собрали AI GitHub-репозитории для разработчика.

Зачем запускать нейросети локально

Облачные нейросети это удобно. Не надо заморачиваться с железом, скачиванием, настройкой и системным промпт-инженерингом, всё уже сделали за вас, но в некоторых случаях установка локальной LLM может быть более разумным решением и вот почему:

Безопасность. Ваши данные не утекают на чужой сервер, а хранятся у вас, локально.

Независимость. Не надо бояться блокировок из-за санкций, смены условий предоставления API, деградации качества ответов от ИИ.

Экономия. Вы тратитесь только на электричество и железо, вам не надо платить провайдеру за токены или подписки.

Работа оффлайн. Нейросеть может запускаться без интернета.

Гибкая настройка. Нейросеть можно дообучить на своих данных, подстраивать под себя, интегрировать в свои продукты.

Какие системные требования нужны для локального AI

Системные требования для локального запуска нейросети зависит от конкретной модели и задач, которые она должна решать. Некоторые ИИ можно запустить даже на смартфоне, для других понадобится железо стоимостью в сотни или даже миллионы рублей.

От чего зависят системные требования при локальном запуске нейросетей

Требования к железу зависят от таких параметров ИИ как:

Размер модели. Чем больше у неё параметров, тем больше она требует памяти. Условные 7–8b проще запустить чем 70b.

- Квантование. Модели можно сжимать, как zip-архивы. Чем сильнее сжата модель, тем меньше она потребляет памяти, но от этого может страдать качество ответов.

- Длина контекста. Как много данных ИИ держит в памяти.

- Задача. Для генерации текста нужен один уровень производительности, для генерации изображений и видео другой.

Полезный блок со скидкой

Если хочется не просто запускать готовые модели, а понимать, как они устроены, развиваться в сторону ML-инженера и зарабатывать больше, — держите промокод Практикума на любой платный курс: KOD (можно просто нажать). Он даст скидку при покупке и позволит сэкономить на обучении.

Бесплатные курсы в Практикуме тоже есть — по всем специальностям и направлениям, начать можно в любой момент, карту привязывать не нужно, если что.

На что обращать внимание при подборе железа

Видеокарта

Нейросети работают с огромным количеством чисел, они перемножают матрицы, считают вероятности, генерируют следующий токен. Для всего этого нужна подходящая видеокарта для нейросетей и много параллельных вычислений. Если у процессоров обычно по 4–16 ядер, то у видеокарт их тысячи, поэтому они лучше справляются с такими вычислениями.

В теории нейросети можно запускать на картах AMD или Intel, но лучше всего для этого подходят карты Nvidia, из-за технологии CUDA.

Но дело не только в вычислениях. Модель нужно где-то хранить, для этого нужна память. Она у видеокарт обычно распаяна на плате, рядом с чипом. При запуске нейросети, GPU не нужно гонять данные туда-сюда, между видеокартой оперативной памятью и процессором, можно всё держать в видеопамяти. Благодаря этому вычисления проходят быстрее.

Оперативная память

Если видеопамяти слишком мало, то нейросеть начинает использовать оперативную память как запасной вариант. Если на устройстве мало памяти, то ИИ либо не запустится, либо будет работать некорректно. Поэтому на ОЗУ тоже не стоит экономить.

Процессор

Если в компьютере есть хорошая видеокарта и достаточно памяти, процессор уже не так критичен. Основную работу с нейросетью берёт на себя видеокарта. Но совсем слабый CPU всё равно может мешать, он отвечает за работу системы, запуск программ, подготовку данных и передачу их видеокарте. Поэтому для локального AI не обязательно покупать самый дорогой процессор, но лучше, чтобы он был хотя бы современным и не превращался в узкое место всей системы.

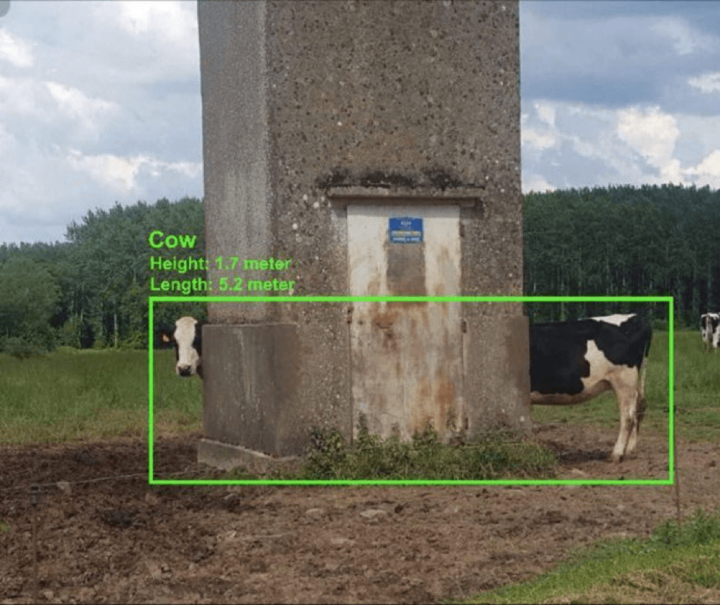

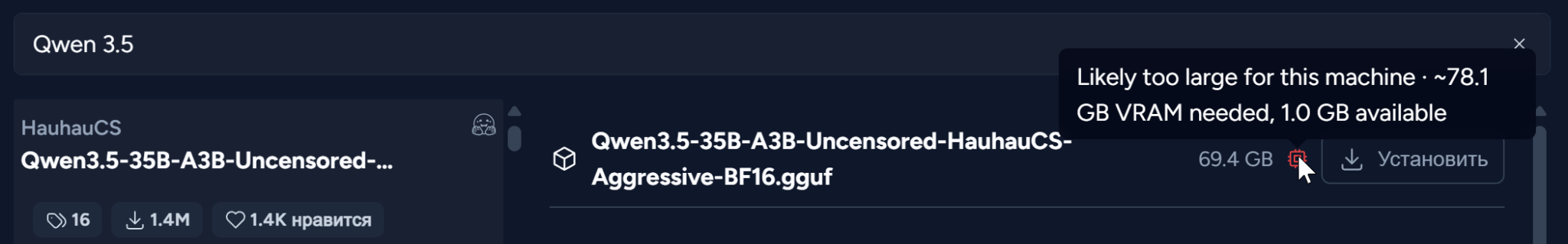

Как узнать, какие нейросети подходят под системные требования компьютера

Проверить, какие нейросети можно установить на ваше устройство, можно двумя способами. А если вы пока выбираете не оболочку, а саму модель, посмотрите подборку китайских нейросетей 2026 года: там есть GLM, DeepSeek, Qwen, Kimi и другие модели под кодинг, агентов, мультимодальность и большие контексты.

Через консольную утилиту llmfit. Она анализирует информацию о системе устройства и показывает варианты локальных моделей, которые на нём запустятся.

Через оболочку по типу LM Studio. Для установки локальных ИИ часто используют специальные программы, в которых эти нейросети можно искать, скачивать, использовать. Часто в таких программах можно посмотреть системные требования к установке той или иной модели. Например, объём VRAM.

10 инструментов для установки локальных нейросетей на ПК

GPT4All — для установки нейросети на ПК без заморочек

GPT4All — это приложение с графическим интерфейсом для локального запуска нейросети на компьютере. Никакого терминала и кода, приложение можно поставить через обычный установщик и пользоваться.

Порог входа: низкий, подойдёт для новичков.

Возможности:

- Установка моделей из 2 каталогов: родной и HugginFace.

- Подключение облачных моделей, например, ChatGPT, через API.

- Запуск локального сервера для интеграции с другими приложениями и скриптами.

Нюансы и недостатки. В родном каталоге мало локальных моделей, редкие обновления, мало возможностей в сравнении с конкурентами, например, нет поддержки MCP или structured output.

Ссылки.

- Официальный сайт: nomic.ai/gpt4all

- Документация: docs.gpt4all.io

- GitHub: github.com/nomic-ai/gpt4all

LM Studio — для запуска ИИ чат-ботов в графическом интерфейсе.

LM Studio — это программа с графическим интерфейсом для запуска локальных ИИ моделей. По своей логике она похожа на GPT4All, но у неё более приятный дизайн и больше возможностей.

Порог входа: низкий, подойдёт тем, кому нужна простота GPT4All, но не хватает дополнительных возможностей.

Возможности:

- Установка нейросетей с HugginFace.

- Поддержка инструментов — функций, которые могут вызывать ИИ.

- Настройка параметров модели, например, температуры, длины контекста.

- Запуск локального сервера. С его помощью можно обращаться к нейросетям из других программ и скриптов.

- Поддержка MCP — протокола для подключения к другим сервисам, данным и инструментам.

- LM Link — нейросеть можно запустить на одном устройстве, а общаться с ней на другом.

Нюансы и недостатки. Установщик весит более 500 мб, LM Studio может потреблять много ресурсов из-за графического интерфейса.

Ссылки:

- Официальный сайт: lmstudio.ai

- Документация: lmstudio.ai/docs

- GitHub: github.com/lmstudio-ai

Ollama — для разработки и личного использования

Ollama — это программа для запуска локальных нейросетей. Она ориентирована в первую очередь на разработчиков. Изначально у Ollama не было графического интерфейса, всё работало через терминал и команды. Со временем интерфейс появился, но по функционалу он отстаёт от терминала.

Порог входа: высокий, для доступа к большинству функций нужен терминал, либо сторонний графический интерфейс по типу Open WebUI.

Возможности:

В графическом интерфейсе можно:

- Устанавливать модели.

- Общаться с ними в чате.

В терминале можно:

- Вызывать инструменты.

- Использовать MCP.

- Запускать локальный сервер для интеграции с внешними проектами.

- Создавать кастомных ИИ-ботов.

- Регулировать настройки моделей, например, температуру или контекстное окно.

- Устанавливать нейросети.

- Общаться с ИИ.

Нюансы и недостатки. Высокий порог входа для новичков и тех, кто не любит работать через терминал, установщик весит 1.8 ГБ.

Ссылки:

- Сайт: https://ollama.com

- Документация: https://docs.ollama.com

- GitHub: https://github.com/ollama/ollama

Jan AI — для запуска ИИ чат-ботов

Jan AI — это бесплатное open-source приложение. В нём можно скачивать локальные модели, запускать их на своём компьютере и общаться с ними в чате, прямо как в LM Studio.

Порог входа: низкий, хорошо подойдёт для новичков.

Возможности:

- Установка и запуск локальных моделей.

- Подключение облачных моделей про API.

- Создание ИИ-ассистентов с отдельными инструкциями.

- Настройка параметров модели, например, структура вывода, длина контекста.

- Локальный API-сервер.

- Поддержка MCP и CLI — специальной консольной утилиты.

Нюансы и недостатки: это молодой проект, который быстро развивается, иногда бывают небольшие баги в интерфейсе.

Ссылки:

- Официальный сайт: https://jan.ai/

- Документация: https://www.jan.ai/docs

- GitHub: https://github.com/janhq/jan

Stable Diffusion Forge Neo — для генерации изображений

Forge Neo — программа, которая работает с Stable Diffusion и другими локальными нейросетями для генерации изображений. Она поднимает локальный сервер и запускает ИИ в графическом интерфейсе.

Порог входа: средний, придётся повозиться с настройкой.

Возможности:

- Генерация изображений по тексту и референсам.

- Перегенерация части изображения при помощи inpaint.

- Настройка параметров генерации, например, количество шагов, стиль, соотношение сторон.

- Подключение расширений с дополнительными функциями, например, для цветокоррекции, добавления водяных знаков.

- Запуск локального сервера для интеграции с другими программами и скриптами.

Нюансы и недостатки. Нельзя скачать и установить локальные нейросети напрямую из Forge Neo. Их нужно устанавливать отдельно. Не самый простой инструмент в плане настройки.

Ссылки:

- Страница проекта: https://github.com/Haoming02/sd-webui-forge-classic/tree/neo

- Документация: https://github.com/Haoming02/sd-webui-forge-classic/wiki

ComfyUI — для генерации изображений, видео, 3D и аудио при помощи нод офлайн

ComfyUI — это программа для локального запуска нейросетей в интерфейсе с нодами. Ноды — это что-то вроде разных этапов, которые визуально выглядят как соединённые между собой карточки. Например, может быть этап генерации изображения, этап улучшения качества, этап генерации видео из изображения.

ComfyUI работает прежде всего с нейросетями для генерации визуала, либо аудио. Текстовую LLM полноценно запустить здесь не получится.

Порог входа: высокий, придётся разбираться с настройками и логикой нод.

Возможности:

- Создание рабочих пространств из нод.

- Установка локальных нейросетей.

- Поддержка ИИ для создания аудио, видео, изображений, 3Д.

- Редактирование сгенерированного контента.

- Настройка параметров генерации, например, можно генерировать изображения определённого формата или стиля.

- Поддержка расширений.

- Подключение нейросетей по API.

- Возможность запустить локальный сервер и использовать нейросети в других проектах.

Нюансы и недостатки. Для новичков система нод может показаться сложной. Некоторые расширения могут конфликтовать с программой после обновлений и мешать её работе. Не подходит для запуска ИИ чат-ботов.

Ссылки:

- Официальный сайт: https://www.comfy.org/

- Документация: https://docs.comfy.org/

- GitHub: https://github.com/Comfy-Org/ComfyUI

Llama.cpp — движок под нейросети для разработчиков

llama.cpp — это open source библиотека на C/C++ для запуска LLM на своём компьютере. По своей логике это скорее движок, на базе которого работают другие проекты, например, Ollama, Jan AI, LM Studio, GPT4All.

Порог входа: высокий, придётся работать в терминале.

Возможности:

- Запуск нейросетей без облачных сервисов.

- Работа с моделями через терминал.

- Запуск локального сервера — например, для подключения к своему приложению.

- Подключение локальной модели к программам, которые обычно работают с OpenAI API.

- Настройка производительности: сколько ресурсов отдавать модели и какую часть вычислений переносить на GPU.

- Сжатие моделей через квантование, чтобы они помещались в память слабого компьютера.

- Ответы в структурированном формате, например, в JSON.

- Есть графический интерфейс, который открывается в браузере.

Нюансы и недостатки. Это решение для разработки, для общения с ИИ чат-ботами не самый удобный инструмент. Модели нужно скачивать и устанавливать отдельно.

Ссылки:

- GitHub: https://github.com/ggml-org/llama.cpp

- Документация: https://github.com/ggml-org/llama.cpp/tree/master/docs

Whisper.cpp — для транскрибации аудио оффлайн

OpenAI знамениты не только ChatGPT, но и линейкой моделей Whisper, которые качественно распознают речь с точностью до 20 мс. Whisper.cpp — это C/C++ библиотек и набор консольных утилит для работы с моделями Whisper.

Порог входа: высокий, нужно будет работать в терминале, либо писать скрипты.

Возможности:

- Скачивание моделей.

- Распознавание речи из аудио.

- Перевод речи на английский.

- Запуск локального сервера.

- Генерация субтитров и тайм-кодов.

- Определение участков, где есть речь, а где тишина.

- Встраивание в приложения через биндинги для Python, JavaScript, Go, Java, Swift, .NET и других языков.

Нюансы и недостатки. Нет графического интерфейса, всё работает через терминал, команды и скрипты.

Ссылки:

- Сайт/демо: https://ggml.ai/whisper.cpp/

- Документация: https://github.com/ggml-org/whisper.cpp/blob/master/README.md

- GitHub: https://github.com/ggml-org/whisper.cpp

Open WebUI — готовый фронтенд под нейросети

Open WebUI — это не программа для прямого запуска нейросетей, а веб-интерфейс для работы с ними. Его можно установить на устройство использовать как фронтенд и подключить к Ollama, LM Studio, GPT4All, они будут выступать в качестве бэкенда.

Порог входа: средний, придётся подключать сторонние сервисы для нормальной работы.

Возможности:

- Интеграция с другими сервисами для нейросетей через локальный сервер.

- Поддержка ИИ для текста, генерации изображений, аудио, распознавания звука.

- Поддержка не только локальных, но и облачных нейросетей.

- Загрузка документов, создание баз знаний, поиск через эмбеддинги и запуск сценариев типа RAG-систем.

- Запуск кода в канвасе, веб-поиск, инструменты, заметки.

- Создание кастомных ИИ-ботов.

- Сортировка чатов по проектам.

Нюансы и недостатки. В Open WebUI нет сразу готового движка для запуска нейросетей, его надо подключать отдельно. Придётся разобраться, что такое Ollama, API, Docker, бэкенд, либо нужно будет установить ещё один сервис с нейросетями по типу LM Studio и подключаться к нему.

Ссылки:

- Сайт: https://openwebui.com

- Документация: https://docs.openwebui.com

- GitHub: https://github.com/open-webui/open-webui

Pinokio — магазин локальных open-source ИИ-приложений

Pinokio — это десктопный лаунчер и каталог приложений. По логике он больше похож на Steam. Вы выбираете приложение, а Pinokio скачивает проект, ставит зависимости и запускает его на компьютере. Среди приложений есть много ИИ-инструментов. Например, можно установить ComfyUI или Open WebUI.

Порог входа: низкий, по логике сервис похож на маркет приложений.

Возможности.

- Установка локальных open source приложений, включая проекты с ИИ-функциями.

- Автоматическая установка зависимостей: Python, Node.js, Git, Conda, пакеты и другие компоненты.

- Установка нескольких копий приложений.

Ссылки:

- Сайт: https://pinokio.co

- Документация: https://pinokio.co/docs

- GitHub: https://github.com/pinokiocomputer/pinokio

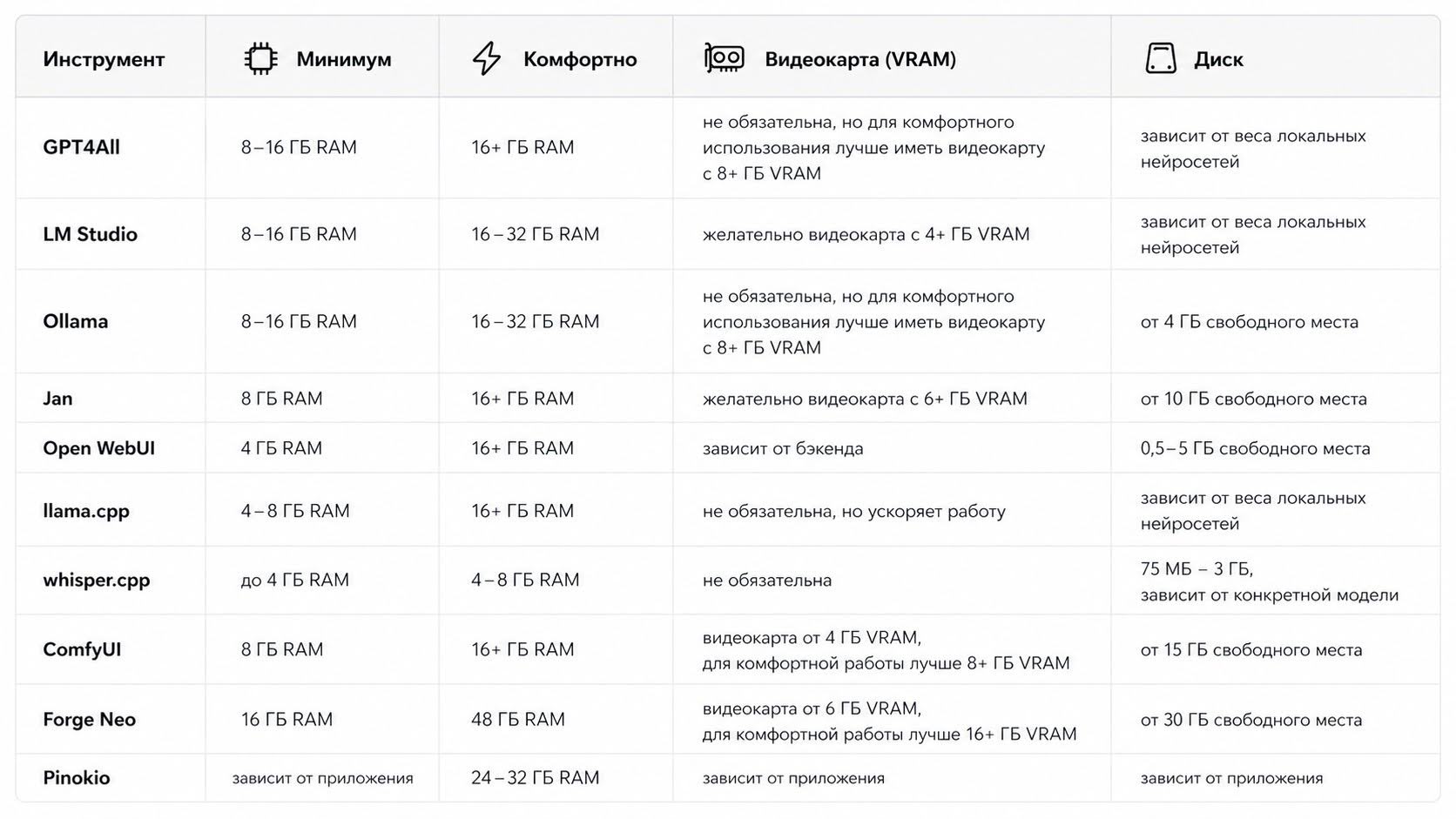

Системные требования инструментов для локального запуска ИИ

Системные требования каждого инструмента зависят от настроек, задач и установленных нейросетей. Если вы запускаете нейросеть на 8 млрд параметров с контекстным окном в 8 тыс. токенов, то будет одна нагрузка на систему, если решите запустить ИИ на 20 млрд параметров с контекстным окном в 200 тыс. токенов, то нагрузка будет уже другой.

В сравнительной таблице ниже указаны минимальные системные требования для инструментов из подборки. Этих требований должно быть достаточно открытия программ и запуска маленьких моделей, например, на 2 млрд параметров.

Сравнительная таблица:

Популярные ошибки при запуске локальных нейросетей

Модель отвечает по 2–3 минуты на простой вопрос. Скорее всего, модель запустилась на CPU вместо видеокарты. В LM Studio стоит посмотреть настройки загрузки модели и GPU Offload, чем больше слоёв уходит на GPU, тем быстрее обычно работает генерация. В Ollama в терминале можно выполнить ollama ps и посмотреть колонку PROCESSOR, если там 100% CPU, модель работает через оперативную память и процессор, а не через видеокарту.

Появляется ошибка out of memory. Такая ошибка обычно означает, что модели не хватает видеопамяти или оперативной памяти. В этом случае помогает более лёгкая версия модели с квантованием, например, Q4 вместо Q8 или FP16. Ещё можно уменьшить объём вычислений, которые уходят на GPU. Для этого в LM Studio есть настройка GPU Offload, а перед загрузкой модели можно оценить примерный расход памяти через команду lms load –estimate-only в терминале.

Модель обрывает русский текст или теряет контекст. Иногда причина не в русском языке, а в слишком маленьком контекстном окне. Контекст — это объём данных, который модель держит в памяти во время ответа. Если он слишком маленький, модель может забывать начало запроса, обрывать длинный текст или хуже работать с документами. В Ollama контекст можно менять через параметр num_ctx, а в LM Studio — через настройку Context Length.

Stable Diffusion Forge Neo падает с ошибкой VRAM. Чаще всего Forge Neo падает, когда модели не хватает видеопамяти, например, из-за тяжёлой модели, высокого разрешения, большого batch size или включённых модулей вроде ControlNet, апскейла и LoRA. В таком случае стоит снизить разрешение, отключить лишние модули, закрыть программы, которые занимают VRAM, или попробовать более лёгкую модель.

Ollama не видит GPU на Windows. Иногда Ollama запускает модель не на видеокарте, а на процессоре. Из-за этого ответы идут намного медленнее. Чтобы проверить, где работает модель, можно ввести в консоли команду ollama ps. Если там написано GPU — всё нормально, модель использует видеокарту. Если CPU — она работает через процессор. Тогда стоит обновить драйвер видеокарты и проверить, поддерживает ли её Ollama.

Итог: с чего начать работу с локальными нейросетями

Это зависит от трёх вещей: производительности устройства, задачи и порога входа. Если вам нужны нейросети для работы с текстом и кодом, вы собираетесь на их базе создавать свои проекты и не боитесь терминала, то вам подойдёт Ollama или Llama.cpp.

Если вам нужны локальные нейросети как замена ChatGPT, чтобы просто общаться в графическом интерфейсе, то лучше выбрать LM Studio или Jan AI.

Если вам нужно генерировать изображения, видео, аудио, 3д и вас не пугает система нод, то вам подойдёт ComfyUI. Для работы только с изображениями без нод можно выбрать Stable Diffusion Forge Neo.

Для распознавания речи хорошим выбором будет Whisper.cpp, а если вы постоянно тестируете AI-приложения, то вам пригодится Pinokio для их установки.

Советуем дополнительно почитать по теме:

- Как стать ML-инженером в 2026 году: от Python до первого оффера — путь из семи этапов с нуля до первого оффера: от математики и Python до деплоя модели в продакшн.

- Как создать AI-агента: пошаговое руководство — если вы попросите чат-бота отменить вашу подписку, он напишет инструкцию из пяти шагов, а AI-агент сам пойдёт в биллинг-систему, проверит тариф и нажмёт кнопку «Отменить».

- 15 скиллов для AI-агентов: установка и как работает в 2026 — что такое agent skills, как устроен SKILL.md и какие 15 скиллов реально меняют вывод агента — с установкой для Claude Code, Cursor и Gemini CLI.

- n8n автоматизация без кода: парсер Telegram за 10 минут — показываем, как настроить автоматизацию в n8n без единой строчки кода и собрать парсер новостей за 10 минут.

- 13 сайтов с готовыми промтами для нейронок — выбирайте и копируйте промты для кодинга, текста и других задач.

Бонус для читателей

Если вам интересно погрузиться в мир ИТ и при этом немного сэкономить, держите наш промокод на курсы Практикума. Он даст вам скидку при оплате, поможет с льготной ипотекой и даст безлимит на маркетплейсах. Ладно, окей, это просто скидка, без остального, но хорошая.